Machine Learning

Muster erkennen, Überleben vorhersagen.

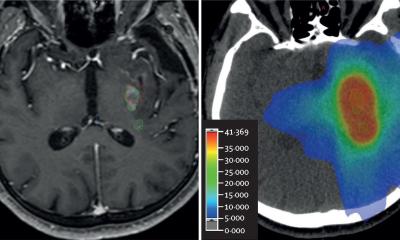

Die Spracherkennung am Smartphone, der Spam-Filter des E-Mail-Programms und die Produktempfehlungen von Amazon oder Netflix haben eines gemeinsam: Sie basieren auf einer Software, die in einer Menge gegebener Daten Muster und Gesetzmäßigkeiten erkennt. Diese künstliche Generierung von Wissen nennt sich maschinelles Lernen. Auch die Radiologie, die riesige Mengen an Bilddaten produziert, wird zunehmend Anwendungsgebiet für maschinelles Lernen: Durch die Analyse von quantitativen Bildmerkmalen in großen medizinischen Bilddatenbanken sollen statistische Aussagen über Gewebeeigenschaften, Diagnosen und Krankheitsverläufe möglich werden.

Bericht: Michael Krassnitzer

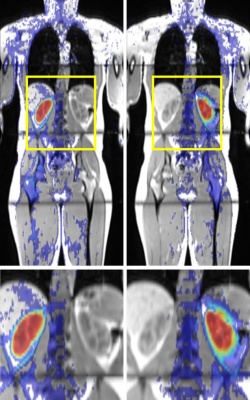

Am Imperial College London zum Beispiel wird ein System namens MALIBO (MAchine Learning In whole Body Oncology) entwickelt, das in Zukunft vollautomatisch Tumoren in Ganzkörper-Magnetresonanztomografien erkennen soll. Bislang hat das System anhand von Ganzkörper-MRTs freiwilliger gesunder Versuchspersonen gelernt, Organe und deren Einzelteile zu identifizieren. Gewissermaßen als Lehrer fungierten Radiologen, die auf den MRT-Bildern die zu erkennenden Strukturen markiert und benannt haben. Danach war das System in der Lage, selbstständig an neuen Ganzkörper-MRTs Organe und deren Einzelteile zu identifizieren. Es wurden gleich zwei verschiedene Methoden des maschinellen Lernens erprobt, wobei sich das Prinzip des künstlichen Neuronalen Netzwerkes – bei dem das Zusammenspiel von Neuronen im Gehirn simuliert wird – besser bewährt als sogenannte Entscheidungswälder, also eine große Menge paralleler Entscheidungsbäume. Mittlerweile ist MALIBO in die zweite Phase eingetreten, wo es bereits um die Erkennung von Primärtumoren geht. „Wir haben schon einige gute Ergebnisse beim Kolorektalkarzinom erzielt“, berichtet Dr Amandeep Sandhu Meng MBBS, einer der am Projekt beteiligten Radiologen.

Dieses ehrgeizige Forschungsprojekt ist nur eines unter vielen, das in einer Session über maschinelles Lernen am European Congress of Radiology (ECR 2017) vorgestellt wurde, der von 1. bis 5. März in der österreichischen Hauptstadt Wien über die Bühne ging. An der Universität von Valencia (Spanien) wurde zum Beispiel ein Algorithmus entwickelt, mit dem auf CT-Aufnahmen von Wirbelsäulen einzelne Wirbelkörper identifiziert und charakterisiert werden. Trainiert mit 200 verschiedenen Aufnahmen gesunder und kranker Wirbelsäulen, bewertete das Programm ihm unbekannte neue Fälle zu 95 Prozent korrekt.

An der Universität von Bari (Italien) haben Forscher ein computergestütztes Entscheidungssystem (CAD) evaluiert, das Läsionen auf MRT-Aufnahmen der Brust detektieren soll. Von 3735 Schnittbildern wurden 192 als auffällig bewertet, darunter waren 102 falsch positive und vier falsch negative. Dieser gute negative Vorhersagewert würde es erlauben, mit dem CAD-System aus einer großen Menge an Fällen jene Mammae herauszufiltern, die die keiner weiteren Untersuchung bedürfen.

Die Universitätsspitäler Zürich und Basel in der Schweiz entwickelten gemeinsam ein analytisches Tool, mit dem sich aus einer Vielzahl von radiologischen Bildern aus unterschiedlichen Quellen und von unterschiedlicher Qualität Rückschlüsse auf das Osteoporoserisiko ziehen lassen. Anhand von179 Bildern von 60 unterschiedlichen Patienten, die von einem Radiologen eingefärbt worden waren, hatte das Neuronale Netzwerk gelernt, aus CT-Aufnahmen quantitative Knocheninformationen abzuleiten. Am Universitätsspital Basel wiederum wurde eine Software namens „PACS Crawler“ entwickelt, die anhand von CT-Aufnahmen das Risiko einer osteoporotischen Fraktur ermittelt.

Und Forscher der Universitätsmedizin Mainz schufen einen Algorithmus, um anhand von präoperativen 3D-CT-Scans das Überleben von Patienten nach einer Lebertransplantation vorherzusagen. Das Programm konnte mit einer Treffsicherheit von 80 Prozent richtig deuten, welche Patienten nach dem Eingriff länger als ein Jahr überleben und welche nicht – ohne dass den Wissenschaftlern klar wurde, nach welchen Kriterien das Programm bei seiner Vorhersage vorging. „Es ist ein bisschen wie eine Kristallkugel: Wie wissen nicht wie – aber es funktioniert“, erklärt Dr. Daniel Pinto dos Santos, Leiter der Forschungsgruppe Radiology Image and Data Science (radIDS).

23.03.2017